да, локально развернуты Devstral-Small-24B-2507-Instruct и Qwen3-Coder-30B. В целом умом не блещут, но вот такую херню, как на видео, щелкают на раз-два. Тупо простой рефакторинг рутинный, когда надо тупо сидеть, 100500 классов вручную тыкать по шаблону - супер выручалка.И как тебе мистрал? Как я понял у тебя локальная версия LM, я не коммерческие версии никогда не юзал.

Установить приложение

Как установить приложение на iOS

Посмотрите видео ниже, чтобы узнать, как установить наш сайт в виде веб-приложения на главном экране.

Примечание: Эта функция может быть недоступна в некоторых браузерах.

Вы используете устаревший браузер. Этот и другие сайты могут отображаться в нём некорректно.

Вам необходимо обновить браузер или попробовать использовать другой.

Вам необходимо обновить браузер или попробовать использовать другой.

Lineage2TS - HF сервер написанный на Typescript

- Автор темы MrThirtyOddSix

- Дата начала

Дополнительные настройки

Кто ответил?Согласен, мне как палочка выручалочка когда нужно огромные массивы языковых пакетов перевести на другие языки или переписать стили CSS, даже стражно представить кол-во проблем сколько сняли с моих плечь )да, локально развернуты Devstral-Small-24B-2507-Instruct и Qwen3-Coder-30B. В целом умом не блещут, но вот такую херню, как на видео, щелкают на раз-два. Тупо простой рефакторинг рутинный, когда надо тупо сидеть, 100500 классов вручную тыкать по шаблону - супер выручалка.

Пусть критикуют. Я не про то что он чем-то выдался или не выдался. Скорее о том что можно услышать про ИИ и то что сейчас происходит. Можно также послушать различные хайповые видео, где все говорят что светлое будущеe уже здесь и тут. Но смысл всетаки остаеться что с этим ИИ делать и как его применять. И скорее как ИИ будет применяться против вас в будущем, будьте вы программистом или нет.Серге́й Вячесла́вович Саве́льев (род. 7 марта 1959, Москва) — советский и российский учёный-биолог, Доктор биологических наук, профессор.

Автор широко критикуемых оригинальных концепций. Высказывания и книги С. В. Савельева неоднократно критиковались учёными и журналистами за большое количество фактических ошибок, антинаучность и некорректность выводов. Дважды номинирован на антипремию ВРАЛ.

Почётный академик ВРАЛ — антипремия, вручаемая «за выдающийся вклад в развитие и распространение лженауки и псевдонауки».

Понял, спасибо, посмотрю

Но я к чему? ИИ будет использоваться, только не в моем проекте. Лицензия проекта тоже токсична для ИИ (AGPL), так что код из проекта не будет просто так интегрироваться в другие коммерческие программы. Вот и все. Для меня это важно.

Как будто ему не похуй на эту лицензию. Вы никогда и никому не докажите, что ваш код использовался для обучения ИИ. Это в принципе нереально доказать) + в ИИ не будет не строчки вашего кода) Она не хранит ваш код в весах и не запоминает его во время обучения. Это просто обучение, продуктом работы которого являются веса модели. Это тоже самое, что заставить меня открыть мой код, после того, как я посмотрел ваш репозиторий, ссылаясь на то, что я использую знания о нем в своей работе)Лицензия проекта тоже токсична для ИИ (AGPL)

Я не хочу тебя расстроить, пусть будет так как ты думаешьНо я к чему? ИИ будет использоваться, только не в моем проекте. Лицензия проекта тоже токсична для ИИ (AGPL), так что код из проекта не будет просто так интегрироваться в другие коммерческие программы. Вот и все. Для меня это важно.

Ну раньше Copilot палился и он мог при автогенерации кода мог вставлять чужие пароли, ключи и с комментариямиКак будто ему не похуй на эту лицензию. Вы никогда и никому не докажите, что ваш код использовался для обучения ИИ. Это в принципе нереально доказать)

Ну тем не менее кода у него нет в весах. Там лишь набор векторов и массивов значений с плавающей точкой. Это синапсы, а не данные. Модели не хранят данные, на которых их обучали.Ну раньше Copilot палился и он мог при автогенерации кода мог вставлять чужие пароли, ключи и с комментариями

хм а есть ссылка на статью, как с этим работать? Вижу работа с моделькой через gui lm. А вот как она получается доступ к файлам не понял, ну и в ide все открывается это чисто фишка плагина к idea? Пока с чем работал это через скрепку в gui чате ну или прям в ide сочетание клавиш по коментам, а вот так что бы по промту сама все открывала и переписывала не встречал )))Не, у нее своя виртуалка со своей отдельной IDE. Она там ничего не натворит, а если натворит, это будет легко понять по гиту. Т.к я ей не поручаю большие задания вне рамок одного коммита. Она трудится сугубо отдельно, под своим Git аккаунтом и присылает мне пулреквесты)

MCP-сервер от идеи + модель которая умеет нативно работать с инструментами.хм а есть ссылка на статью, как с этим работать? Вижу работа с моделькой через gui lm. А вот как она получается доступ к файлам не понял, ну и в ide все открывается это чисто фишка плагина к idea? Пока с чем работал это через скрепку в gui чате ну или прям в ide сочетание клавиш по коментам, а вот так что бы по промту сама все открывала и переписывала не встречал )))

спасибо за инфу)MCP-сервер от идеи + модель которая умеет нативно работать с инструментами.

спасибо за инфу)

Вы не можете просматривать ссылку пожалуйста воспользуйтесь следующими ссылками Вход или Регистрация

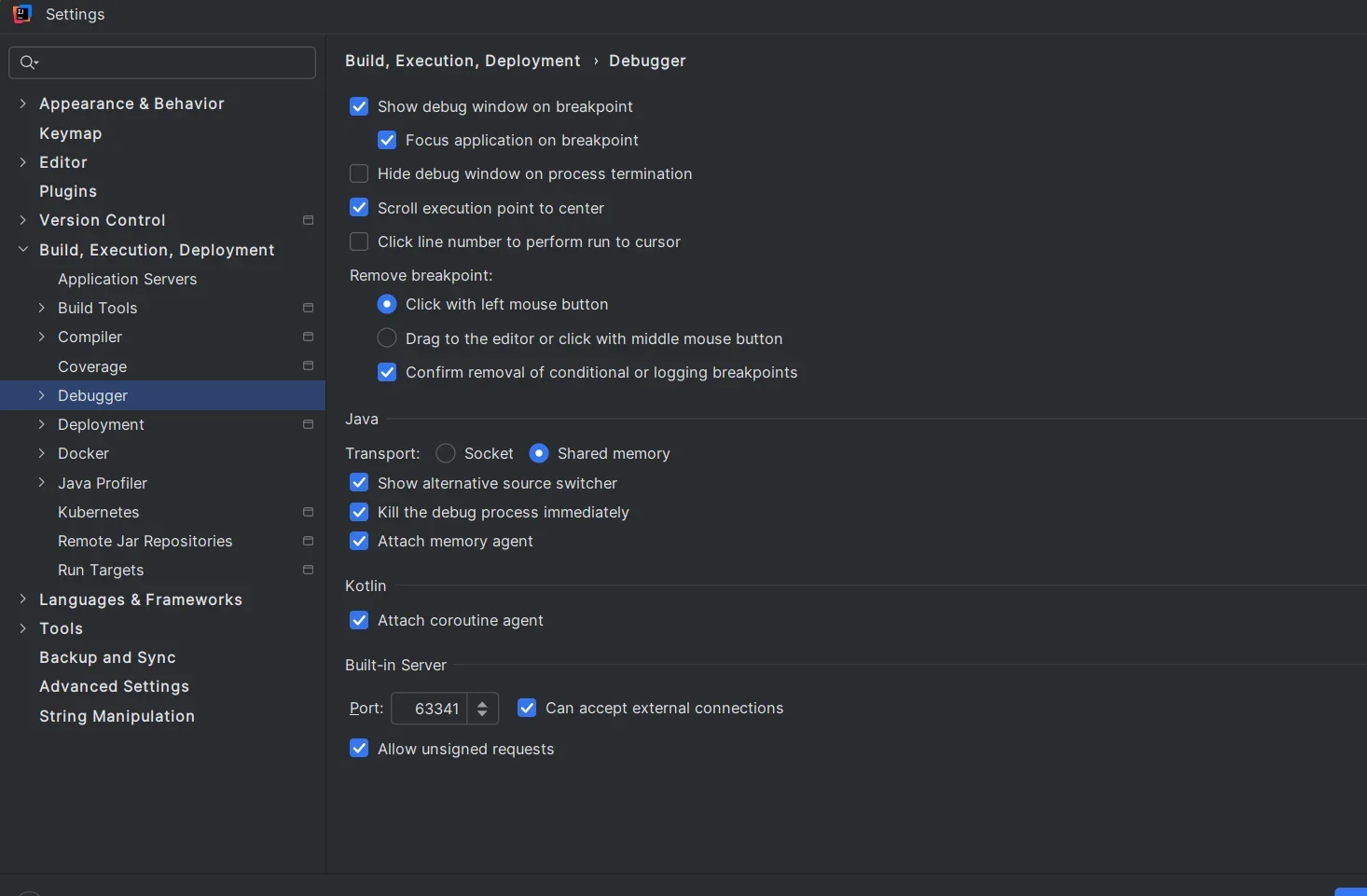

Порт в дебагере изменить на не стандартный, разрешить доступ с внешки. MCP сервер ставить как плагин из маркетплейса Jetbrains.

Вы не можете просматривать ссылку пожалуйста воспользуйтесь следующими ссылками Вход или Регистрация

После этого, подключить MCP к LLM. Я использую ChatBox и цепляю к своей локальной LM Studio. ChatBox поддерживает импорт MCP из JSON.

по этому был выбран, в принципе можно любой?ChatBox поддерживает импорт MCP из JSON.

Да любой можно, конечно. Я просто взял первый попавшийся кроссплатформенный GUI, которые умеет в OpenAI API и MCP, т.к виртуалка с идеей у бота на лине.по этому был выбран, в принципе можно любой?

Если хочешь что-то на богатом, то

Вы не можете просматривать ссылку пожалуйста воспользуйтесь следующими ссылками Вход или Регистрация

подключай, но это для богатых, 5$ на миллион токенов, улетят мгновенно, но качество лучше чем у фришек.Ну я сложный код даже умной сетке не доверю, а мелочь и локально крутится неплохо. У меня 48гб vram, могу крутить 30b модели с контекстом 256к на изи)Если хочешь что-то на богатом, тоВы не можете просматривать ссылку пожалуйста воспользуйтесь следующими ссылками Вход или Регистрацияподключай, но это для богатых, 5$ на миллион токенов, улетят мгновенно, но качество лучше чем у фришек.

вот если бы кликом кнопки в маркете плагинов ставилось можно было бы подумать))а так за бабки еще и самому прикручивать хехеЕсли хочешь что-то на богатом, тоВы не можете просматривать ссылку пожалуйста воспользуйтесь следующими ссылками Вход или Регистрацияподключай, но это для богатых, 5$ на миллион токенов, улетят мгновенно, но качество лучше чем у фришек.

Я проверял все что есть, и платные (покупал подписки) и бесплатные. Разница между фри и платными огромная.Ну я сложный код даже умной сетке не доверю, а мелочь и локально крутится неплохо. У меня 48гб vram, могу крутить 30b модели с контекстом 256к на изи)

По качеству ответов и верности результата

Гугл: дам 5/10 (огромный плюс что можно загрузить репозиторий до 100мб файлов)

GPT (тогда была o1): 7/10.

Claude (Opus): 8/10.

Всё другое не больше 3/10.

Тогда юзай курсор, чтоб не было попаболи и не парить голову.вот если бы кликом кнопки в маркете плагинов ставилось можно было бы подумать))а так за бабки еще и самому прикручивать хехе

Да все зависит от промта, насколько он грамотно составлен. Юзал гпт и дип +- равны и пишут одно и тоже. Гпт только бесплатных попыток мало на топ модель, а остальные сильно хуже дипсика.GPT: 7/10.

Ты про агентов или вообще про мозги ЛЛМ в целом?Я проверял все что есть, и платные (покупал подписки) и бесплатные. Разница между фри и платными огромная.

По качеству ответов и верности результата

Гугл: дам 5/10 (огромный плюс что можно загрузить репозиторий до 100мб файлов)

GPT: 7/10.

Claude (Opus): 8/10.

Всё другое не больше 3/10.

Если для меня брать самую умную - то это Gemini Pro 2.5 Она в рамках AI Studio халявная и контекст 1кк это овердохуя. + Ей можно кормить файлы из Google Drive и не париться за размер, но я ее иногда юзаю, чтобы писать джавадоки на огромные классы, когда ты сначала ее кормишь класс, потом просишь объяснить как она поняла логику, потом корректируешь и объясняешь какие-то важные вещи и она рожает класс на 10к строк, где каждый метод покрыт досконально качественными и очень крутыми доками. Причем все это бесплатно)

Вот, например враппер: